自然语言处理(NLP, Natural Language Processing)作为人工智能的一个重要分支,近年来得到了广泛的关注和应用。无论你是AI初学者还是有经验的开发者,深刻理解NLP的基本概念和应用场景都是非常必要的。本文将带你从零开始,全面了解NLP的核心知识与技术。

一、什么是自然语言处理?

自然语言处理是计算机科学、人工智能和语言学的交叉领域,它致力于研究如何通过计算机处理和分析人类自然语言,使计算机能够理解、解释和生成自然语言。

NLP的主要任务

NLP的任务可以大致分为以下几类:

- 文本预处理:包括分词、词性标注、去停用词、词干提取等。

- 文本分类:如垃圾邮件检测、情感分析等。

- 命名实体识别(NER):识别文本中的实体,如人名、地名、组织等。

- 机器翻译:将一种语言的文本翻译成另一种语言。

- 文本生成:如文章摘要生成、对话系统等。

二、NLP的基本步骤

1. 文本预处理

文本预处理是自然语言处理(NLP)的基础步骤,其主要目的是将原始的文本数据转换为易于分析和建模的形式。预处理步骤至关重要,因为它直接影响后续分析和模型的效果。以下是文本预处理的几个关键步骤:

1.1 分词(Tokenization)

分词是指将文本切分成独立的词语或标记。对于英语等西方语言,分词相对简单,只需按空格和标点符号切分即可。然而,对于中文等没有明显词边界的语言,分词则复杂得多,需要借助一些特定的工具和算法。常用的分词工具有:

- Jieba:一个优秀的中文分词工具,支持精确模式、全模式和搜索引擎模式。

- THULAC:清华大学推出的中文词法分析工具,支持分词和词性标注。

分词方法主要有两类:

- 基于规则的分词:利用预定义的词典和规则进行分词,这种方法简单直观,但对新词和模糊词的处理较差。

- 基于统计的分词:使用统计模型(如条件随机场CRF)从大规模语料中学习分词规律,能够更好地处理新词和歧义词。

1.2 去停用词(Stop Words Removal)

停用词是指在文本中频繁出现但对文本分析无实际意义的词语,如中文中的“的”、“了”、“在”,英文中的“the”、“is”、“at”等。去除停用词的目的是减少噪音,提高模型的性能。处理方法包括:

- 使用预定义的停用词表:根据语言和应用场景选择合适的停用词表进行过滤。

- 自定义停用词表:根据具体的应用场景和需求,手动添加或删除停用词。

1.3 词干提取(Stemming)与词形还原(Lemmatization)

词干提取是将词语还原为其词干形式的过程,如将“running”还原为“run”。词形还原则是将词语还原为其基本形式,考虑了词性和语法规则,如将“better”还原为“good”。

- 词干提取:常用的算法有Porter Stemmer、Lancaster Stemmer等。这些算法通过一系列规则和步骤去掉单词的词缀。

- 词形还原:基于词典和语言规则进行处理,常用工具如NLTK库中的WordNet Lemmatizer。

1.4 小写转换(Lowercasing)

将文本中的所有字母转换为小写,以统一文本格式,减少因大小写不同而导致的词语重复问题。例如,将“Apple”和“apple”都转换为“apple”。

1.5 去除标点符号(Removing Punctuation)

移除文本中的标点符号,以减少噪音,使得模型更专注于词语本身。这一步通常与分词结合进行。

1.6 拼写纠正(Spell Correction)

对文本中的拼写错误进行纠正,提高文本的质量和一致性。这一步在处理用户生成内容(如社交媒体评论)时特别有用。常用的拼写纠正工具有:

- SymSpell:一个基于编辑距离的高效拼写纠正算法。

- Hunspell:一个常用的拼写检查和纠正库。

1.7 其他预处理步骤

- 去除空白字符:去掉文本中的多余空白字符,以简化文本格式。

- 归一化处理:包括数字归一化(如将所有数字转换为一个统一的标记)和日期归一化(将不同格式的日期统一为一种格式)。

- 文本标准化:处理缩写、口语化表达等,将其转换为标准形式。

通过一系列预处理步骤,原始文本数据被转换为结构化的、易于分析的形式,为后续的特征提取和模型训练奠定了坚实的基础。文本预处理看似简单,但每一步都有其复杂度和技术挑战,需要根据具体的应用场景和需求进行调整和优化。

2. 特征提取

特征提取是自然语言处理(NLP)中的关键步骤之一。它的目的在于从预处理后的文本中提取出有意义的特征,以便后续的模型能够更好地理解和学习文本数据。特征提取的质量直接影响到模型的性能,因此,选择合适的特征提取方法至关重要。以下是几种常见的特征提取技术:

2.1 词袋模型(Bag of Words, BoW)

词袋模型是最简单且常用的文本特征表示方法之一。它将文本表示为词频向量,忽略词语的顺序和语法关系。具体步骤如下:

- 构建词汇表:从所有文档中提取唯一词语,构建词汇表。

- 生成词频向量:根据词汇表,将每个文档转换为词频向量,记录每个词在文档中出现的次数。

这种方法简单直接,但也存在一些问题,如词汇表过于庞大、忽略词序和语义信息等。

2.2 TF-IDF(Term Frequency-Inverse Document Frequency)

TF-IDF是一种改进的词袋模型,它不仅考虑词频,还考虑词语在整个语料库中的重要性。TF-IDF值由两部分组成:

-

词频(TF):某词在文档中出现的频率。

-

逆文档频率(IDF):某词在整个语料库中出现的稀有程度。计算公式为:

[ \text{IDF}(t) = \log \frac{N}{df(t) + 1} ]

其中,(N)为文档总数,(df(t))为包含词(t)的文档数。

TF-IDF的计算公式为:

[ \text{TF-IDF}(t, d) = \text{TF}(t, d) \times \text{IDF}(t) ]

这种方法能够有效提升重要词语的权重,降低常见词语的影响。

2.3 词嵌入(Word Embeddings)

词嵌入是将词语映射到低维连续向量空间的一种方法,能够捕捉词语的语义信息和上下文关系。常用的词嵌入模型包括:

- Word2Vec:谷歌提出的词嵌入方法,包括CBOW(Continuous Bag of Words)和Skip-Gram两种模型。Word2Vec能够捕捉词语之间的语义相似性。

- GloVe(Global Vectors for Word Representation):斯坦福大学提出的方法,通过全局共现矩阵进行词嵌入学习。

- FastText:Facebook提出的方法,考虑了词的子词特征,能够更好地处理未登录词和形态学丰富的语言。

2.4 文档嵌入(Document Embeddings)

除了词嵌入,文档嵌入则是将整个文档映射到向量空间。常用方法有:

- Doc2Vec:Word2Vec的扩展,能够生成固定长度的文档向量。包括PV-DM(Distributed Memory)和PV-DBOW(Distributed Bag of Words)两种模型。

- TF-IDF加权平均词向量:使用TF-IDF权重对词嵌入进行加权平均,生成文档向量。

2.5 主题模型(Topic Modeling)

主题模型用于发现文档中的潜在主题。常用的主题模型有:

- LDA(Latent Dirichlet Allocation):一种生成模型,假设文档是由多个主题混合生成的,每个主题由一组词语组成。LDA能够提取文档的主题分布。

- NMF(Non-negative Matrix Factorization):一种矩阵分解方法,通过分解词-文档矩阵,提取文档的主题特征。

2.6 N-gram 模型

N-gram模型将文本分割成连续的N个词语或字符的组合,能够捕捉局部的词序信息。常见的N-gram包括:

- Unigram(1-gram):单个词语。

- Bigram(2-gram):连续两个词语。

- Trigram(3-gram):连续三个词语。

N-gram模型在捕捉短距离依赖关系时非常有效,但随着N值的增加,计算复杂度也会显著提升。

2.7 特征工程

特征工程是根据具体任务对特征进行改进和优化的过程,包括:

- 特征选择:选择最具代表性的特征,去除冗余特征。常用方法有基于相关性的选择、基于模型的重要性评分的选择等。

- 特征组合:将多个特征进行组合,生成新的特征。

- 特征缩放:对数值特征进行标准化或归一化处理,以消除特征尺度的影响。

通过上述特征提取方法和特征工程技术,可以从文本数据中提取出丰富的特征,为后续的模型训练和预测提供坚实的基础。特征提取不仅是一个技术问题,更需要结合具体的应用场景和任务需求,进行不断地调整和优化。

3. 模型训练与评估

在完成文本预处理和特征提取之后,接下来就是将这些特征输入到机器学习或深度学习模型中进行训练与评估。模型训练的目标是使模型能够学习到数据中的模式,从而在新数据上做出准确的预测。评估则是为了衡量模型的性能,并进行优化和调参。以下是模型训练与评估的主要步骤和方法:

3.1 数据集划分

为了评估模型的性能,通常需要将数据集划分为训练集、验证集和测试集。

- 训练集:用于训练模型,即模型学习的主要数据来源。

- 验证集:用于模型调参和选择最佳模型,帮助防止过拟合。

- 测试集:用于最终评估模型的性能,确保模型的泛化能力。

常见的划分比例为70%训练集、15%验证集、15%测试集,具体比例可根据实际情况调整。

3.2 模型选择

根据具体的任务和数据特点,选择合适的模型进行训练。常见的模型有:

- 传统机器学习模型:如朴素贝叶斯、支持向量机(SVM)、随机森林、K近邻(KNN)等。这些模型适用于小规模数据和特征较为简单的任务。

- 深度学习模型:如循环神经网络(RNN)、长短期记忆网络(LSTM)、卷积神经网络(CNN)等。这些模型擅长处理复杂结构和大规模数据,尤其在自然语言处理任务中表现优异。

- 预训练语言模型:如BERT、GPT等。这些模型在大规模语料库上预训练,具有强大的语言理解和生成能力,适用于各种NLP任务。

3.3 模型训练

模型训练是通过迭代优化过程,使模型参数逐步收敛到最佳状态的过程。训练过程中的关键步骤包括:

- 定义损失函数:损失函数用于衡量模型预测与真实值之间的差距,常见的损失函数有交叉熵损失、均方误差等。

- 选择优化算法:优化算法用于最小化损失函数,常用的优化算法有梯度下降、Adam、RMSprop等。

- 训练过程:通过不断迭代,更新模型参数,直到损失函数收敛或达到预设的训练轮数(epoch)。

3.4 模型评估

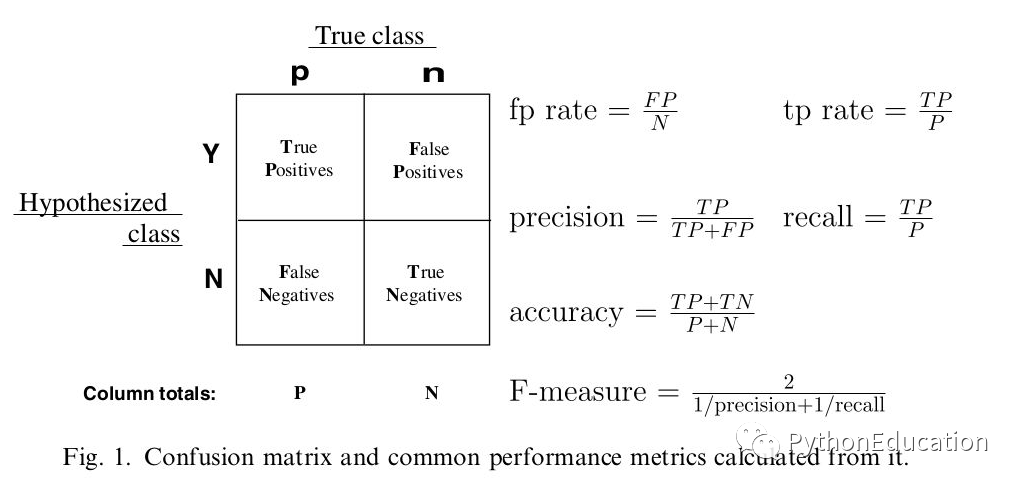

在训练完成后,需要对模型进行评估,以验证其在新数据上的表现。常见的评估指标有:

- 准确率(Accuracy):预测正确的样本占总样本的比例,适用于类别平衡的数据集。

- 精确率(Precision)和召回率(Recall):精确率衡量预测为正的样本中实际为正的比例,召回率衡量实际为正的样本中被正确预测为正的比例,适用于类别不平衡的数据集。

- F1值(F1 Score):精确率和召回率的调和平均数,综合考虑了模型的精确性和完整性。

- ROC曲线(Receiver Operating Characteristic Curve)和AUC值(Area Under Curve):用于评估模型的分类能力,曲线下面积越大,模型性能越好。

3.5 模型调参与优化

在模型评估过程中,可能需要对模型进行调参和优化,以提升模型性能。常见的调参方法有:

- 网格搜索(Grid Search):对所有可能的参数组合进行穷举搜索,找到最佳参数组合。

- 随机搜索(Random Search):在参数空间中随机采样,进行参数搜索,通常比网格搜索更高效。

- 贝叶斯优化(Bayesian Optimization):利用贝叶斯理论,选择最有可能提升模型性能的参数进行搜索。

3.6 模型正则化

为了防止模型过拟合,可以采用正则化技术。常见的正则化方法有:

- L1正则化:通过引入L1范数(即参数的绝对值和)来约束模型参数,促使部分参数为零,从而实现特征选择。

- L2正则化:通过引入L2范数(即参数的平方和)来约束模型参数,使参数值更小、更平滑。

- Dropout:在每次训练中随机丢弃一定比例的神经元,防止神经网络过拟合。

3.7 模型集成

模型集成是通过结合多个模型的预测结果,提高整体预测性能的技术。常见的集成方法有:

- Bagging:如随机森林,通过训练多个决策树并将它们的预测结果进行投票或平均。

- Boosting:如梯度提升决策树(GBDT)、XGBoost,通过逐步训练多个弱模型,每个模型在前一个模型的基础上进行改进。

- Stacking:通过训练多个基础模型,并将它们的预测结果作为新的特征,输入到第二层模型进行最终预测。

通过上述步骤,能够有效地训练和评估NLP模型,确保其在实际应用中的性能和稳定性。模型训练与评估不仅是一个技术问题,更需要不断地实验和调优,以找到最适合具体任务的解决方案。

三、NLP的应用场景

NLP在实际生活中有广泛的应用,以下是几个典型的应用场景:

- 智能客服:通过NLP技术实现自动化的客户服务和问题解答。

- 文本挖掘:从大量文本数据中提取有价值的信息,如金融分析、舆情监控等。

- 机器翻译:如Google翻译、百度翻译等应用。

- 对话系统:如Siri、Alexa等智能助手。

四、总结

自然语言处理作为一门跨学科领域,涉及到计算机科学、人工智能和语言学等多个方面。掌握NLP的基本概念和技术,不仅能提升你的技术能力,还能让你在AI领域的职业发展中获得更多机会。希望本文能帮助你快速入门NLP,开启你的自然语言处理之旅!